۵ دیدگاه

محمد حسین

۱۷ آذر ۱۴۰۲، ۱۳:۰۶

نازنین کریمی مقدم

۱۸ آذر ۱۴۰۲، ۱۲:۵۸

mitra

۰۶ آبان ۱۴۰۲، ۱۱:۴۱

بابک حیدری

۲۰ تیر ۱۴۰۲، ۱۴:۱۹

نازنین کریمی مقدم

۲۳ تیر ۱۴۰۲، ۱۷:۰۹

دوره الفبای برنامه نویسی با هدف انتخاب زبان برنامه نویسی مناسب برای شما و پاسخگویی به سوالات متداول در شروع یادگیری موقتا رایگان شد:

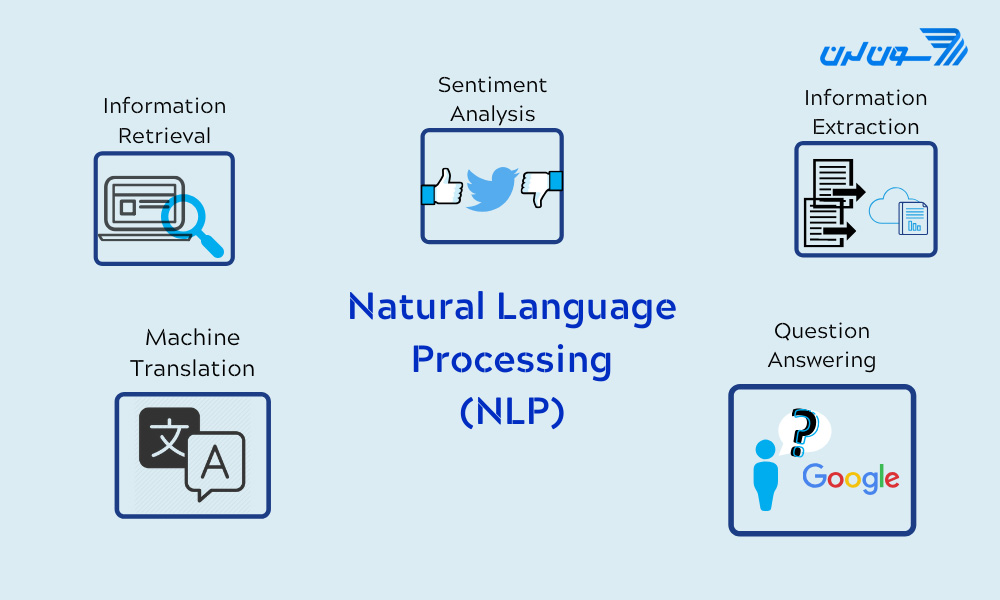

در سال 1957، ساختارهای نحوی نوام چامسکی، زبان شناسی را با « گرامر جهانی » متحول کرد. این ساختارها سیستمی مبتنی بر قوانین نحوی یک زبان بودند. سپس بودجه برای مدتی در حوزه پردازش زبان طبیعی به طور چشمگیری کاهش یافت و در نتیجه تحقیقات کمی در این زمینه تا اواخر دهه 1980 انجام شد. پس تا دهه 1980، اکثر سیستمهای NLP براساس مجموعه ای پیچیده از قوانین دست نوشته بودند. با شروع از اواخر دهه 1980، با معرفی الگوریتمهای یادگیری ماشین در زمینه پردازش زبان، انقلابی در NLP رخ داد. بسیاری از موفقیتهای قابل توجه بعدی در این زمینه به واسطه مدلهای آماری پیچیدهتری توسعه یافتند، اتفاق افتاد. تحقیقات اخیر نیز به طور فزاینده ای بر روی الگوریتمهای یادگیری بدون نظارت و نیمه نظارتی متمرکز شده است.

در سال 1957، ساختارهای نحوی نوام چامسکی، زبان شناسی را با « گرامر جهانی » متحول کرد. این ساختارها سیستمی مبتنی بر قوانین نحوی یک زبان بودند. سپس بودجه برای مدتی در حوزه پردازش زبان طبیعی به طور چشمگیری کاهش یافت و در نتیجه تحقیقات کمی در این زمینه تا اواخر دهه 1980 انجام شد. پس تا دهه 1980، اکثر سیستمهای NLP براساس مجموعه ای پیچیده از قوانین دست نوشته بودند. با شروع از اواخر دهه 1980، با معرفی الگوریتمهای یادگیری ماشین در زمینه پردازش زبان، انقلابی در NLP رخ داد. بسیاری از موفقیتهای قابل توجه بعدی در این زمینه به واسطه مدلهای آماری پیچیدهتری توسعه یافتند، اتفاق افتاد. تحقیقات اخیر نیز به طور فزاینده ای بر روی الگوریتمهای یادگیری بدون نظارت و نیمه نظارتی متمرکز شده است.